澳洲幸运5app下载 微软推出Maia 200 进步 AI 推理门槛

微软(Microsoft) 推出了 Maia 200,这是其用于驱动 AI 责任负载的自研芯片的最新迭代版块。Maia 200 领有一些令东谈主印象潜入的数据,包括 10 petaflops 的 FP4 算力和 216GB 的HBM3,这让 Microsoft 止境 Azure 云在 AI Token 生成方面得回了立竿见影的进步。更紧迫的是,这给了 Microsoft在自研 AI 加快器方面越过 AWS 和 Google Cloud 的底气。

Microsoft 暗示,Maia 200 是其首款挑升处治 AI 性能挑战的芯片。除了原始的数字运算能力,AI 推理还需要多数高速内存,以及内存和处理器之间的高速贯穿。Maia 200 似乎在这两个方面齐有所斩获。

Maia 200 给与台积电 3nm (纳米)工艺栽种,功耗瞎想(TDP)为 750 瓦。Maia 200 的中枢包含两个试验引擎:一个是用于高隐隐量矩阵乘法和卷积的 Tile Tensor Unit(TTU:Tile 张量处理单位),复旧 FP8、FP6和 FP4 精度;另一个是用于 SIMD(单提示多数据)提示的 Tile Vector Processor(TVP:Tile 向量处理器),提供 FP8、BF16和 FP32 处理能力。TTU 和 TVP 试验引擎联接到 216GB 的高带宽内存(HBM3)以及 272MB 的片上TSRAM(Tile 静态就地存取存储器)。

Maia 200 配备了一个径直内存看望(DMA)子系统,用于在 TSRAM 和TTU 之间保握数据流动,以及一个小的 Tile Control Processor(TCP:Tile 截至处理器)来合营TTU 和 DMA 之间的责任。

凭据 Azure 工程博客中 Saurabh Dighe(系统与架构副总裁)和 Artour Levin(AI 硅工程副总裁)撰写的 Maia 200 深度默契,Maia 200 架构的一个决定性特征是其丰富的内存和内存脉络结构。“这种雄壮的片上内存资源复旧无为的各式低蔓延、高带宽的数据照看战略。”他们写谈。“CSRAM 和 TSRAM齐是完好意思软件照看的,允许栽种者——或编译器/启动时——详情味地舍弃和固定数据,以精准截至数据的局部性和迁移。”

Maia 200 芯片配备了片上以太网收集接口卡(NIC),与相邻芯片之间提供每秒 2.8 TB 的双向带宽。据 Dighe 和 Levin 先容,Maia 200 给与了“两层、纵向彭胀”拓扑结构,蚁合了基于以太网的纵向彭胀互连,可在包含多达 6,144 个加快器的集群中提供高带宽、低蔓延通讯。

Microsoft 暗示,它不错在一个“两层、纵向彭胀”集群拓扑中联接多达6,144 个 Maia 200 加快器。

据 Dighe 和Levin 称,Maia 200 的 Tile 级处理能力,蚁合 DMA 和片上收集能力,澳洲幸运5使芯片或者达到现在大限度 AI 责任负载所需的无为限度。“DMA 引擎专为多通谈、高带宽传输而瞎想,复旧 1D/2D/3D 步进迁移,使常见的 ML 张量布局或者在片上 SRAM、HBM和外部接口之间高效迁移,同期终了数据迁移与筹谋的重复,”他们写谈。“同期,NoC 在集群和内存子系统之间提供可彭胀、低蔓延的通讯,并复旧单播和多播传输——这是分发张量块和合营并行试验的紧迫能力。”

{jz:field.toptypename/}距离 Microsoft 推出 Maia 100——其首款挑升用于 AI 推理的第一代 AI 加快器——刚刚往时两年多。Maia 100 给与台积电 5 纳米工艺栽种,提供每秒 1.8 TB 的双向内存带宽和 64GB SRAM。它提供 3.2 petaflops 的 MXFP4 性能和 1.6 petaflops 的 FP8 或 MXInt8 性能,苟简是Maia 200 的三分之一。

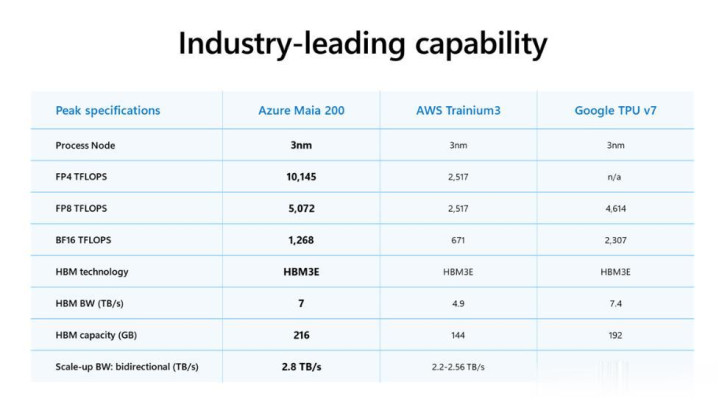

Maia 200 的能力与其他顶级 AI 加快器相称,使其成为“AI 推理能源源”,Microsoft 云和 AI 试验副总裁 Scott Guthrie 暗示:“本色上,Maia 200 不错爽直启动现在最大的模子,并为改日更大的模子留出迷漫的空间。”“Maia 200 是来自任何超大限度云劳动商的最遒劲的第一方硅芯片,其 FP4 性能是第三代 Amazon Trainium 的三倍,FP8 性能高于 Google 第七代 TPU。”他还补充说:“Maia 200 亦然 Microsoft 部署过的最高效的推理系统,与咫尺咱们机群中的最新代硬件比较,性能进步了 30%。”

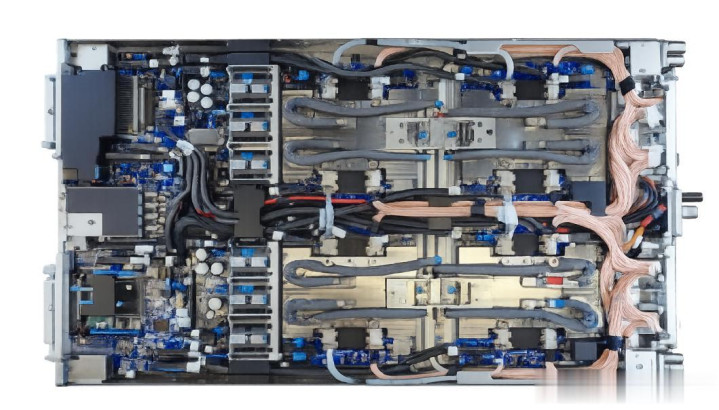

Maia 200 可在风冷和水冷环境中启动。它的瞎想旨在与 Azure 的第三方 GPU 机群协同责任,并死守机架、电源和机械架构的法式。它集成到 Azure 的原生截至平面中,Microsoft 这使得部署和劳动变得安若泰山,同期与归并数据中心空间内的其他 AI 加快器融合共存。

Microsoft 筹算使用其 Maia 200 芯片启动各式模子,包括最新的 OpenAI GPT-5.2 模子。它还将用于生成合成数据,供 AI 模子用于考试方向。新芯片咫尺部署在 Microsoft 位于爱荷华州得梅因近邻的 Central 数据中心区域。它接下来将部署在亚利桑那州凤凰城近邻的 US West 3 数据中心区域,改日还会有更多区域跟进。

备案号:

备案号: